人間の脳の中の信号は電気信号。

これを読み取って、人間の思考の研究がされているが、AIの導入で更なる発展があるという。

複雑すぎて読み取れなかった信号のデータ群をAIが解明している。

脳梗塞などでまひをした患者への治療などへの活用の検討が進められている。

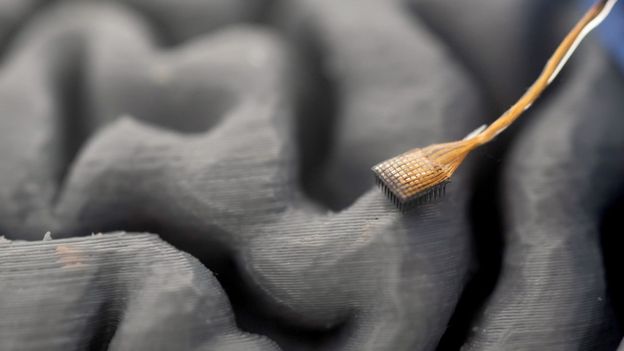

脳の中にセンサーを入れて、その信号から思考をテキストとしてSCREENに表示する。そんな実験が行われているのだ。

BBCより、

How AI can read our scrambled inner thoughts

19 hours agoShareSave

Laurie Clarke

AIで脳の機能解明はどこまで進んだ?「心の声」を文字・音声に近づける研究の現在地と限界

「AIが脳を読める時代が来た」と聞くと、ちょっとSFすぎて、しかも少し怖い話に見えます。

でも実際に進んでいる研究は、“なんでもかんでも心を丸裸にする魔法”というより、まずは失語・麻痺などで話せない人のコミュニケーションを助ける技術として前進している、というのが大事なポイントです。

そもそも何を読んでいるのか? 脳の「電気信号」とAI

脳内ではニューロン(神経細胞)の活動に伴って電気的な信号が生じます。BCI(Brain-Computer Interface:ブレイン・コンピューター・インターフェース)は、その信号を記録し、機械学習(AI)でパターンを読み取って、文字や音声、カーソル操作などに変換する技術です。Stanford/NIHの解説でも、運動皮質の信号から「試みた発話」や「内なる発話(inner speech)」をデコードする研究が進んでいることが示されています。

何が新しいのか? AIで「複雑すぎる信号」の解釈が前進

従来からBCI研究はありましたが、最近の進展の大きな理由は、AIが大量で複雑な脳信号のパターンを扱いやすくしたことです。

たとえばUC Davisの研究では、ALS患者の脳活動をリアルタイムで音声に変換するシステムが報告され、イントネーションや短いメロディ(歌うような表現)まで再現する方向に進んでいます。UC Davisの発表では、遅延は約1/40秒とされています。

「思ったことがそのまま全部バレる」のか? → そこまでは全然いっていない

ここ、いちばん大事です。

NIHのまとめでは、Stanfordの研究は内言(頭の中の言葉)をリアルタイムでデコードする可能性を示した一方で、無意図の内言(言うつもりのない心の声)まで拾ってしまう懸念も明記されています。研究チームは対策として、

- attempted speech(発話しようとした信号)と inner speech(内言)を区別して後者を黙らせる方法

- 特定キーワードで“解除”されたときだけ内言をデコードする方法(キーワード認識は98%以上)

を検討しています。つまり研究者側も、最初から「怖さ」を認識して設計しているわけです。

文字だけでなく、「見ているもの・思い浮かべたもの」の記述にも進展

さらに、日本の関連研究として、fMRI(脳活動を血流変化から測る非侵襲計測)とAIを組み合わせ、**見た映像や思い出した映像内容を文章として生成する“Mind Captioning”**が報告されています。NTTの発表および公開論文(PMC掲載)では、動画を見た/想起したときの脳活動から、意味的に整った説明文を生成する方法が示されています。

ただしこれも、いわゆる「何でも瞬時に心を読める」話ではありません。研究条件はかなり限定的で、fMRI計測・実験設計・学習プロセスが必要です。PMC公開論文でも、対象は6名の健常参加者(日本語母語話者)で、研究は高度に制御された条件で行われています。

現段階の到達点(ここは冷静に)

実用化が見えている領域

- 麻痺やALSなどで話せない人の支援(文字化・音声化)

- より自然な会話に近づけるためのリアルタイム化

- テキストだけでなく抑揚・速度・リズムなどの表現要素の再現

これらは「医療・福祉の強い実需」がある分野です。

まだ難しい領域

- 自由な思考をそのまま高精度に読む

- 文脈を完全に理解した“本音”抽出

- 日常環境で誰にでも使える形での安定運用

- プライバシー・同意・人権の整理

要するに、“マインドリーディングの雰囲気”は出てきたが、万能の読心術ではないです。ここを混同すると、期待も恐怖も暴走しやすい。

怖いのは技術そのものだけじゃない

この分野は「すごい」と「怖い」が同時に来ます。

でも本当に怖いのは、技術より先に運用ルールが雑なことです。

- 誰の同意で計測するのか

- 何を保存するのか

- どこまで医療利用で、どこから監視利用になるのか

- 誤読したとき誰が責任を負うのか

AIが脳信号を扱えるようになるほど、必要なのは「性能」だけでなく、倫理・法制度・設計の慎重さです。NIHが無意図デコード防止策に触れているのは、その入口としてかなり重要です。

まとめ

AIで脳の機能解明は、たしかに進んでいます。

ただし現状は、映画みたいに「思った瞬間に全部バレる」段階ではなく、主に医療支援のために、限定条件で脳信号を文字・音声・説明文へ変換する研究が前進している段階です。

夢はある。怖さもある。

だからこそ、ここは“AIすごい!”だけでも“怖いから全部ダメ!”だけでもなく、仕組みと限界を理解して追うのがいちばん賢い見方です

コメント